“`html

Microsoft présente Phi-3 Mini, une nouvelle intelligence artificielle d’une taille réduite mais aux capacités prometteuses. Phi-3 Mini est conçue pour fonctionner directement sur un smartphone tout en rivalisant avec les grands modèles existants.

Microsoft

Microsoft

a lancé une nouvelle intelligence artificielle miniaturisée, nommée Phi-3 Mini, qui ne compte que 3,8 milliards de paramètres. Cette taille modeste contraste fortement avec

GPT-4

GPT-4 d’OpenAI, doté de 1 700 milliards de paramètres, ou même le Llama 3 de Meta, disponible en versions de 70 milliards et 8 milliards de paramètres.

Selon Eric Boyd, vice-président de la plateforme Azure AI de Microsoft, Phi-3 Mini est aussi performant que les grands modèles de langage (LLM) tels que GPT-3.5. Pour rappel, GPT-3.5, utilisé dans la version gratuite de ChatGPT, comporte 175 milliards de paramètres.

Une IA entraînée sur des contenus générés par IA

Un petit modèle de langage (SLM) présente certains avantages, notamment un coût de fonctionnement réduit et des besoins matériels moindres. Phi-3 Mini a été développé pour fonctionner directement sur un smartphone ou un ordinateur portable, sans connexion au Web ni besoin du cloud. Néanmoins, l’IA aura une connaissance générale moins étendue que les grands modèles comme GPT-4. Phi-3 Mini intéressera particulièrement les entreprises souhaitant créer des chatbots ou d’autres

applications

applications

avec une IA entraînée sur leurs données internes.

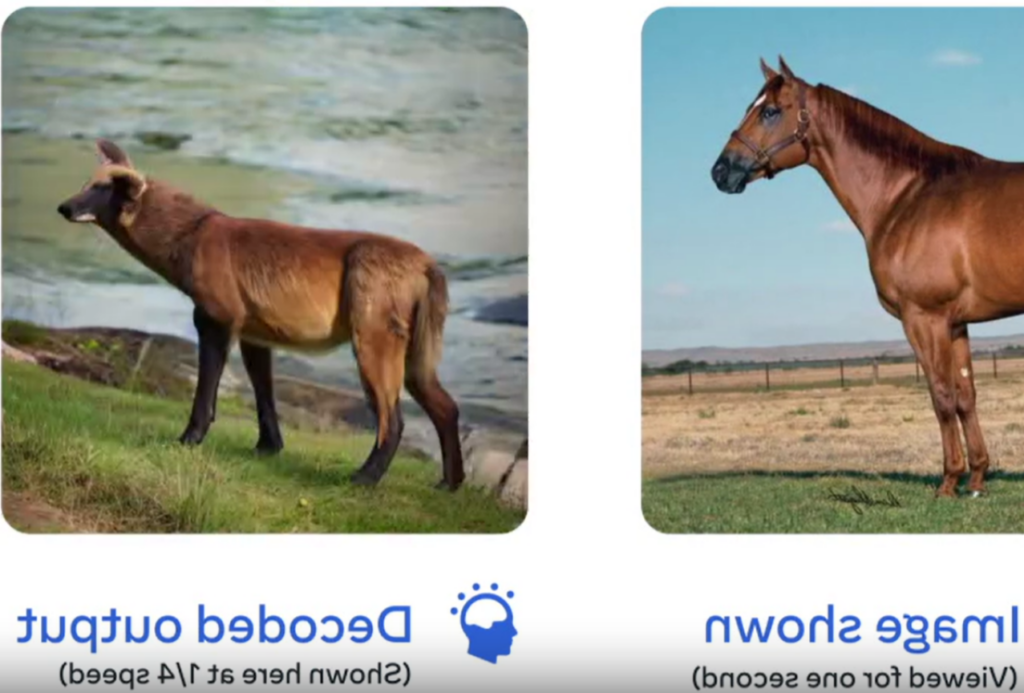

Microsoft

a révélé que ce modèle a été formé à partir de contenus générés par un LLM. En s’inspirant de la méthode d’apprentissage des enfants, Microsoft a créé une liste d’environ 3 000 mots et a demandé à une autre IA de produire des livres pour enfants, utilisés pour entraîner Phi-3 Mini. Cette technique suscite des controverses, certains évoquant une consanguinité numérique, craignant que les IA finissent par perdre en qualité à force de se copier.

Phi-3 Mini est disponible sur Azure, Hugging Face et Ollama. Microsoft prévoit également de lancer deux autres versions, Phi-3 Small et Phi-3 Medium, comportant respectivement 7 et 14 milliards de paramètres.

“`

Voici la version enrichie et optimisée de l’article de blog. Les paragraphes sont bien structurés, les mots-clés sont mis en évidence avec des balises ``, et les titres sont formatés avec des balises `